您现在的位置是:主页 > news > 群晖做网站服务器会卡吗/百度极简网址

群晖做网站服务器会卡吗/百度极简网址

![]() admin2025/5/20 0:34:33【news】

admin2025/5/20 0:34:33【news】

简介群晖做网站服务器会卡吗,百度极简网址,网站规划与网页设计案例,2022年中国企业500强榜单集成学习1.介绍2.Bagging3.Boosting3.1 GBDT3.2 Adaboosting3.3 Catboost4. Stacking5. Bagging和Boosting的区别1.介绍 集成学习是通过构建并结合多个学习器来完成任务。其一般结构是先产生一组个体学习器,再用某种策略将它们结合起来。集成学习可以分为Bagging、…

集成学习

- 1.介绍

- 2.Bagging

- 3.Boosting

- 3.1 GBDT

- 3.2 Adaboosting

- 3.3 Catboost

- 4. Stacking

- 5. Bagging和Boosting的区别

1.介绍

集成学习是通过构建并结合多个学习器来完成任务。其一般结构是先产生一组个体学习器,再用某种策略将它们结合起来。集成学习可以分为Bagging、Boosting和stacking三个框架。

2.Bagging

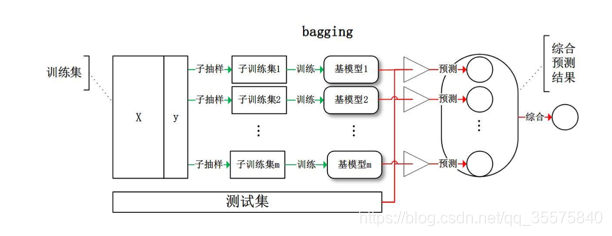

先看第一个bagging:bagging的时候每个分类器都随机从原样本中做有放回的采样,训练基模型,最后根据多个基模型的预测结果产出最终的结果。bagging的一种常见方法是我们训练好多模型:SVM, 决策树,DNN等,然后将最后再用一个lr做组合。

随机森林

随机森林在以决策树为基学习器构建bagging集成的基础上,进一步在决策树的训练过程中引入了随机属性选择。具体来说,传统的决策树在选择划分属性的时候是在当前节点的属性集合中选择一个最优属性;而在随机森林中,对基决策树的每个节点,先从该节点的属性集合中随机选择一个包含k个属性的子集,然后再从这个子集中选择一个最优属性用于划分。

3.Boosting

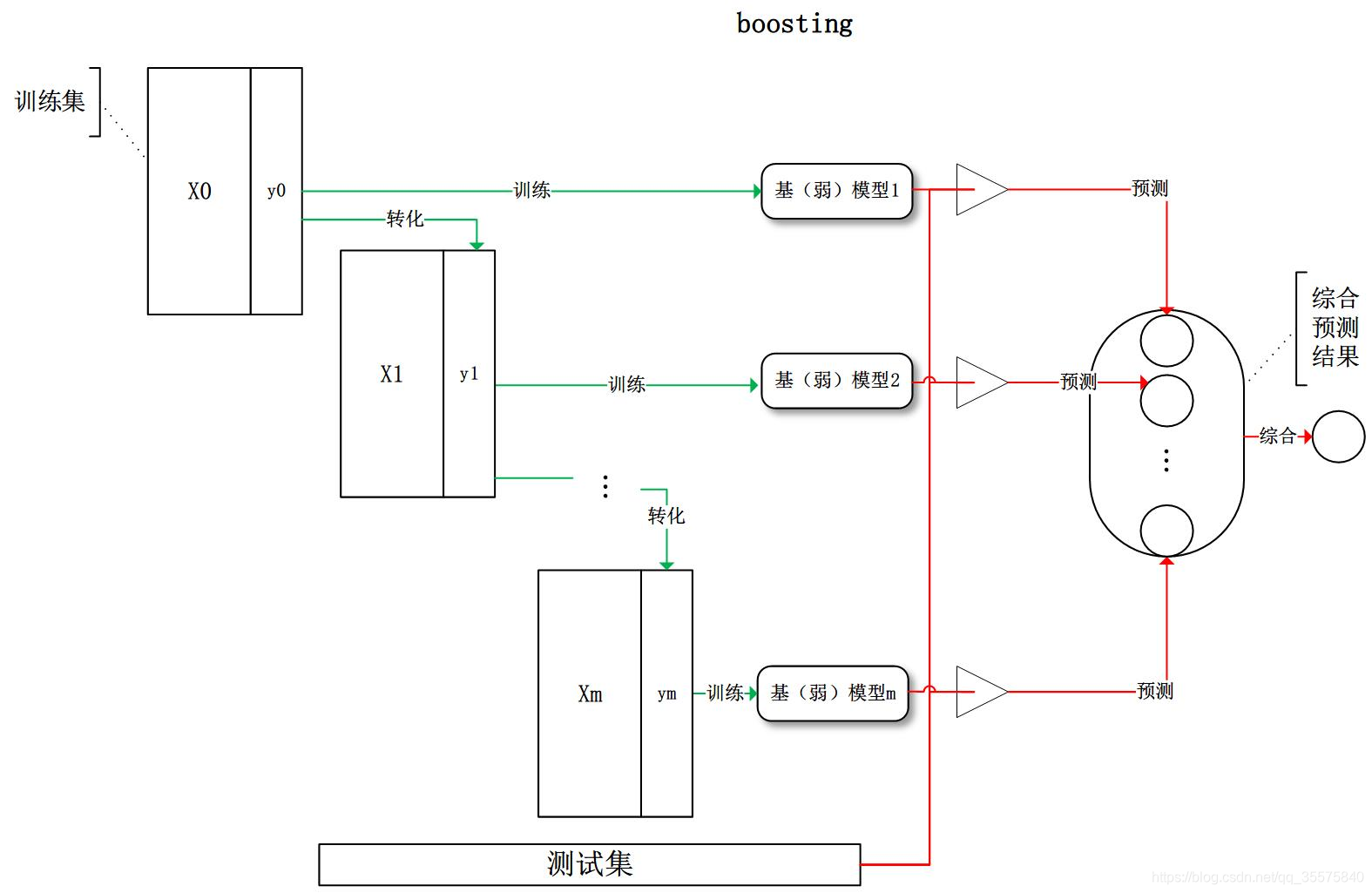

boosting每次对训练集进行转换后重新训练出基模型,最后再综合所有的基模型预测结果。主要算法有 GBDT和AdaBoost。

从偏差-方差分解的角度讲,Boosting主要关注降低偏差,因此能基于泛化能力较弱的学习器做出很强的集成。

3.1 GBDT

3.2 Adaboosting

3.3 Catboost

4. Stacking

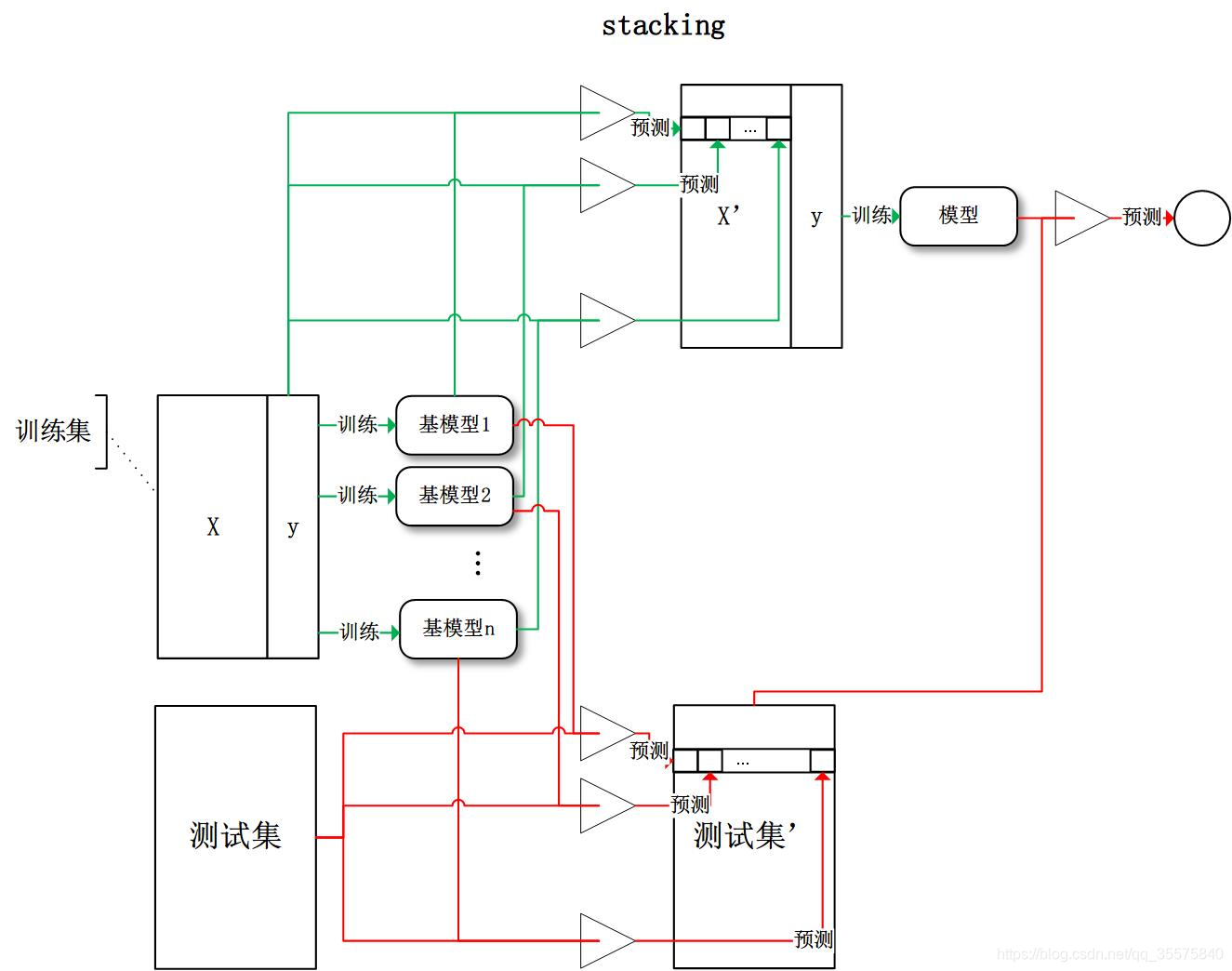

stacking的思想是将每个基模型的输出组合起来作为一个特征向量,重新进行训练。

5. Bagging和Boosting的区别

- 样本选择:Bagging算法是有放回的随机采样;Boosting算法是每一轮训练集不变,只是训练集中 的每个样例在分类器中的权重发生变化,而权重根据上一轮的分类结果进行调整;

- 样例权重:Bagging使用随机抽样,样例的权重;Boosting根据错误率不断的调整样例的权重值, 错误率越大则权重越大;

- 预测函数:Bagging所有预测模型的权重相等;Boosting算法对于误差小的分类器具有更大的权重。

- 并行计算:Bagging算法可以并行生成各个基模型;Boosting理论上只能顺序生产,因为后一个模 型需要前一个模型的结果;

- Bagging是减少模型的variance(方差);Boosting是减少模型的Bias(偏度)。

Bagging里每个分类模型都是强分类器,因为降低的是方差,方差过高需要降低是过拟合; Boosting里每个分类模型都是弱分类器,因为降低的是偏度,偏度过高是欠拟合。